10 consejos para evitar riesgos legales con el uso de la IA

Compartir noticia

Escuchar

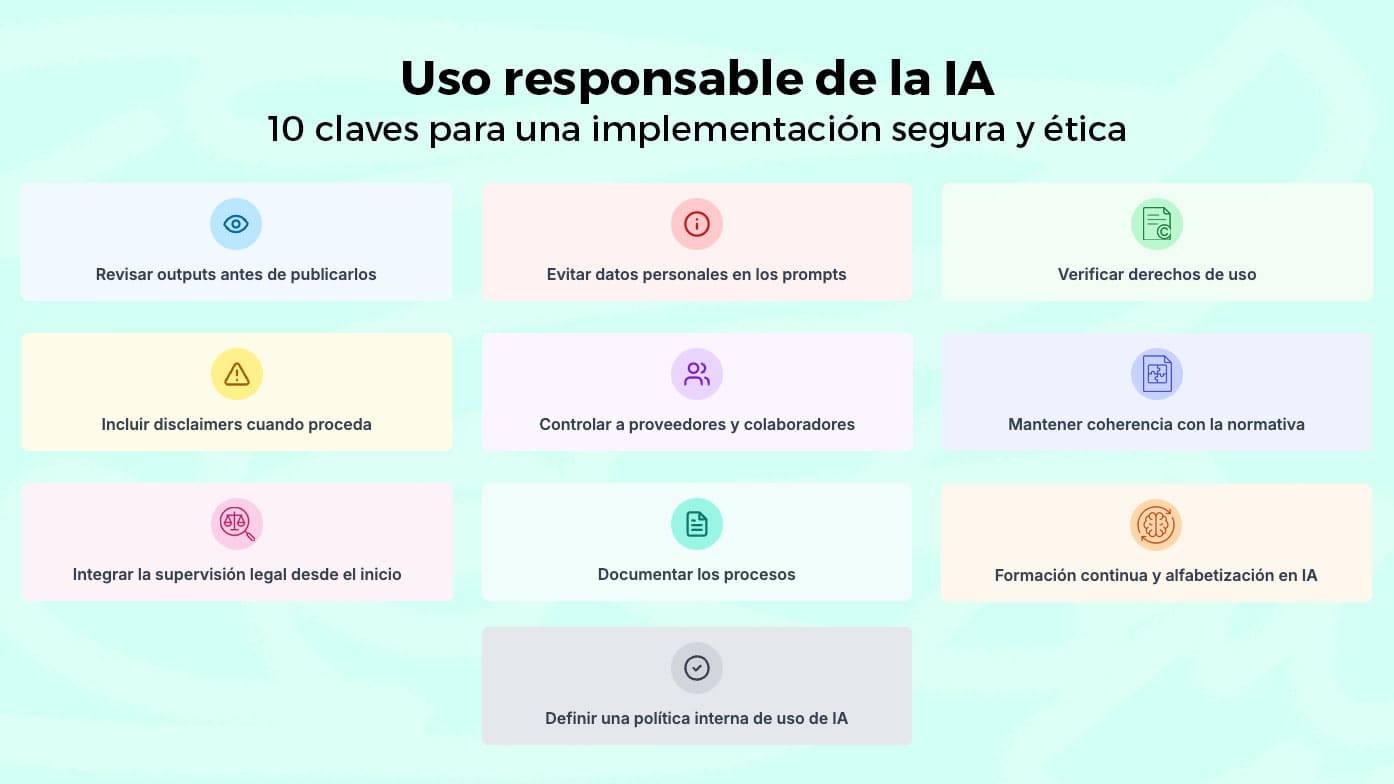

1. Revisar outputs antes de publicarlos

Nunca publiques un contenido generado por IA sin una revisión humana exhaustiva. La supervisión no solo evita infracciones legales, también garantiza coherencia y calidad de marca.

“La IA es una herramienta, no un sustituto del criterio humano”, comenta Guillermo Prado, CEO de Externia. “En una ocasión, una IA incluyó el logotipo antiguo de un cliente en un vídeo promocional. No era un error legal, pero sí una incoherencia visual que habría afectado la imagen del proyecto”.

Carlota Bravo-Ferrer, abogada especializada en derecho digital, añade: “la supervisión humana no es opcional. La ley europea de IA pone el foco precisamente en la accountability o responsabilidad humana sobre el resultado final. La decisión última nunca puede recaer en un algoritmo”.

La revisión es también clave para mantener la voz de marca: la IA puede escribir aceptablemente, pero no sabe quién eres ni qué tono comunica tu identidad.

2. Evitar datos personales en los prompts a la IA

No se deben introducir datos personales o información confidencial sin un motivo legítimo y sin medidas de seguridad adecuadas.

“El Reglamento General de Protección de Datos (RGPD) sigue plenamente vigente en estos entornos”, recuerda Carlota. “Si introduces información personal o sensible en una herramienta de IA sin garantías de privacidad, estás realizando un tratamiento de datos y, por tanto, asumiendo responsabilidad legal sobre ese uso”.

Guillermo complementa: “sí es cierto que la IA necesita contexto para ofrecer buenos resultados. Si trabajas con información sensible, por ejemplo, el lanzamiento de un nuevo producto, asegúrate de hacerlo en entornos controlados y lo más importante: con el consentimiento del propietario de los datos”.

Siempre que sea posible, utiliza versiones empresariales o seguras de las herramientas de IA, que garanticen confidencialidad y no retengan información.

3. Verificar derechos de uso

Antes de publicar, asegúrate de que los outputs no reproducen obras, marcas o elementos protegidos.

“El hecho de que una imagen o un texto lo haya generado una IA no significa que sea libre de derechos”, explica Carlota. “El contenido podría derivar de material protegido utilizado en el entrenamiento del modelo, lo que abriría la puerta a posibles reclamaciones por infracción de copyright”.

Conviene aplicar un doble filtro: buscar coincidencias visuales o textuales y consultar las políticas de derechos y licencias de la herramienta utilizada.

4. Incluir disclaimers cuando proceda

La transparencia es un principio fundamental del AI Act europeo. Desde EDPO (AI Act Representative) se recuerda que toda campaña que utilice contenido visual generado por IA debe informar expresamente al público sobre su origen artificial.

“Los consumidores tienen derecho a saber cuándo están interactuando con contenidos creados por una máquina”, apunta Carlota. “Ocultar ese dato podría considerarse una falta de transparencia o incluso publicidad engañosa si induce a confusión”.

Más allá de lo legal, esta práctica fortalece la confianza del público. Un aviso tan simple como “algunas imágenes de esta campaña han sido creadas con inteligencia artificial” transmite honestidad y refuerza la reputación de la marca.

5. Controlar a los proveedores y colaboradores

Firma acuerdos que regulen confidencialidad, propiedad intelectual, cumplimiento normativo y tratamiento de datos.

“El proveedor debe ser una extensión de tu responsabilidad”, subraya Guillermo. “No puedes delegar la ética o el cumplimiento en terceros”.

Carlota complementa: “incluir cláusulas específicas sobre IA en los contratos con proveedores o agencias es cada vez más recomendable. Así se delimitan las responsabilidades ante posibles infracciones de derechos o usos indebidos de datos”.

Verifica siempre que las agencias o plataformas externas cumplen el RGPD. Muchas herramientas gratuitas aún no lo hacen.

Si quieres saber más sobre… ¿Qué impacto tendrá la utilización de la IA en los eventos? ¿La IA hará desaparecer ciertos puestos de trabajo? ¿Qué seremos capaces de hacer en eventos dentro de cinco años gracias a su uso?

Lee el artículo sobre IA en nuestra revista eventos Magazine 108

6. Mantener coherencia con la normativa sectorial

La IA no te exime de cumplir las reglas que ya existen.

Carlota nos matiza: “los principios de veracidad, lealtad comercial o protección del consumidor siguen siendo los mismos. Si antes no podías anunciar algo que no era cierto, la automatización no lo hace más lícito”.

Las normas sobre competencia, publicidad, consumo o veracidad siguen plenamente vigentes, también en el entorno digital.

7. Integrar la supervisión legal desde el inicio

El equipo jurídico debe participar desde la fase de diseño, no solo al final del proceso.

“El reto está en anticipar, no en corregir”, señala Carlota. “Involucrar al departamento legal desde la ideación permite detectar riesgos antes de que sea demasiado tarde”.

Guillermo coincide: “no se trata de revisar cada pieza, sino de establecer protocolos y formaciones internas que garanticen un uso responsable”.

Crea checklists de validación, plantillas de prompts aprobados o listas de herramientas autorizadas por el área de compliance.

8. Documentar los procesos

Llevar un registro de los prompts, outputs y decisiones es una práctica de transparencia y protección.

“La documentación es la mejor defensa ante una posible auditoría o reclamación”, afirma Carlota. “Demuestra que has actuado con diligencia y dentro del marco legal”.

Guillermo añade: “sirve tanto para cubrirte ante una reclamación como para replicar casos de éxito. Guardar la trazabilidad de los proyectos es tan útil como seguro”.

9. Formación continua y alfabetización en IA

La formación ya no es opcional: es una obligación ética y competitiva.

“Las organizaciones deben garantizar que sus equipos entienden cómo funciona la IA, qué riesgos existen y qué prácticas están prohibidas”, explica Carlota.

“Todos los departamentos deben comprender los límites y el potencial de la herramienta”, coincide Guillermo. “La formación no es solo para expertos, sino para todos los que la usan en su día a día”.

10. Definir una política interna de uso de IA

Cada vez más empresas crean su propia política interna de IA, que establece normas claras sobre cómo y con qué límites se puede utilizar la tecnología. Tener una política definida reduce riesgos, mejora la transparencia y profesionaliza el uso de la IA dentro de la empresa.